Лабораторная работа № 1. Измерение информации

(1 неделя, 2 часа)

Формула Шеннона

В общем случае, энтропия H и количество получаемой в результате снятия неопределенности информации I зависят от исходного количества рассматриваемых вариантов N и априорных вероятностей реализации каждого из них P: {p0, p1, …pN-1}, т.е. H=F(N, P). Расчет энтропии в этом случае производится по формуле Шеннона, предложенной им в 1948 году в статье "Математическая теория связи".

В частном случае, когда все варианты равновероятны, остается зависимость только от количества рассматриваемых вариантов, т.е. H=F(N). В этом случае формула Шеннона значительно упрощается и совпадает с формулой Хартли, которая впервые была предложена американским инженером Ральфом Хартли в 1928 году, т.е. не 20 лет раньше.

Формула Шеннона имеет следующий вид:

(1)

(1)

Знак минус в формуле (1) не означает, что энтропия – отрицательная величина. Объясняется это тем, что pi<=1 по определению, а логарифм числа меньшего единицы - величина отрицательная. По свойству логарифма  , поэтому эту формулу можно записать и во втором варианте, без минуса перед знаком суммы.

, поэтому эту формулу можно записать и во втором варианте, без минуса перед знаком суммы.

интерпретируется как частное количество информации Ii, получаемое в случае реализации i-ого варианта. Энтропия в формуле Шеннона является средней характеристикой – математическим ожиданием распределения случайной величины {I0, I1, … IN-1}.

интерпретируется как частное количество информации Ii, получаемое в случае реализации i-ого варианта. Энтропия в формуле Шеннона является средней характеристикой – математическим ожиданием распределения случайной величины {I0, I1, … IN-1}.

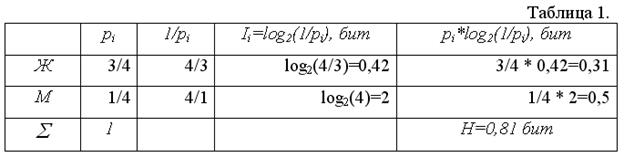

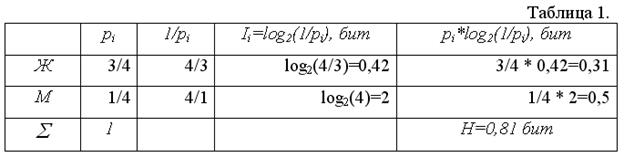

Приведем пример расчета энтропии по формуле Шеннона. Пусть в некотором учреждении состав работников распределяется так: ¾ - женщины, ¼ - мужчины. Тогда неопределенность, например, относительно того, кого вы встретите первым, зайдя в учреждение, будет рассчитана рядом действий, показанных в таблице 1.

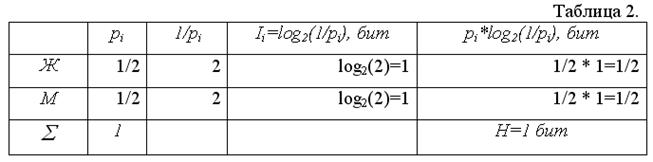

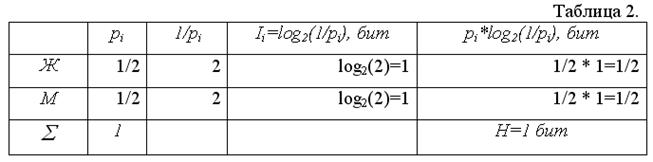

Если же априори известно, что мужчин и женщин в учреждении поровну (два равновероятных варианта), то при расчете по той же формуле мы должны получить неопределенность в 1 бит. Проверка этого предположения проведена в таблице 2.

Формула Хартли

Мы уже упоминали, что формула Хартли – частный случай формулы Шеннона для равновероятных альтернатив.

Подставив в формулу (1) вместо pi его (в равновероятном случае не зависящее от i) значение  , получим:

, получим:

, таким образом, формула Хартли выглядит очень просто:

, таким образом, формула Хартли выглядит очень просто:

(2)

(2)

Из нее явно следует, что чем больше количество альтернатив (N), тем больше неопределенность (H). Эти величины связаны в формуле (2) не линейно, а через двоичный логарифм. Логарифмирование по основанию 2 и приводит количество вариантов к единицам измерения информации – битам.

Задачи для решения

1. Априори известно, что шарик находится в одной из трех урн: А, В или С. Определите, сколько бит информации содержит сообщение о том, что он находится в урне В. Варианты: 1 бит, 1,58 бита, 2 бита, 2,25 бита.

2. Вероятность первого события составляет 0,5, а второго и третьего 0,25. Чему для такого распределения равна информационная энтропия. Варианты: 0,5 бита, 1 бит, 1,5 бита, 2 бита, 2,5 бита, 3 бита.

3. Вот список сотрудников некоторой организации:

| Год рождения

| Фамилия

| Имя

|

| 1970

| Иванова

| Марина

|

| 1970

| Иванова

| Наталья

|

| 1970

| Петрова

| Татьяна

|

| 1970

| Звягина

| Ирина

|

Определите количество информации, недостающее для того, чтобы выполнить следующие просьбы:

a) Пожалуйста, позовите к телефону Иванову.

b) Меня интересует одна ваша сотрудница, она 1970 года рождения.

4. Какое из сообщений несет больше информации:

- В результате подбрасывания монеты (орел, решка) выпала решка.

- На светофоре (красный, желтый, зеленый) сейчас горит зеленый свет.

- В результате подбрасывания игральной кости (1, 2, 3, 4, 5, 6) выпало 3 очка.

5. Объем сообщения, содержащего 1024 символов, составил 1/512 часть Мбайта. Определить мощность алфавита.

(1)

(1) , поэтому эту формулу можно записать и во втором варианте, без минуса перед знаком суммы.

, поэтому эту формулу можно записать и во втором варианте, без минуса перед знаком суммы. интерпретируется как частное количество информации Ii, получаемое в случае реализации i-ого варианта. Энтропия в формуле Шеннона является средней характеристикой – математическим ожиданием распределения случайной величины {I0, I1, … IN-1}.

интерпретируется как частное количество информации Ii, получаемое в случае реализации i-ого варианта. Энтропия в формуле Шеннона является средней характеристикой – математическим ожиданием распределения случайной величины {I0, I1, … IN-1}.

, получим:

, получим: , таким образом, формула Хартли выглядит очень просто:

, таким образом, формула Хартли выглядит очень просто: (2)

(2)